L’ho già notato in passato, ma sembra che non abbiamo imparato nulla dagli impatti negativi causati dall’ascesa dei social media e ora siamo pronti a replicare gli stessi errori con l’introduzione dell’IA generativa.

Infatti, se da un lato l’IA generativa è in grado di fornire una serie di benefici, in diversi modi, dall’altro ci sono anche potenziali implicazioni negative derivanti dall’aumento della nostra dipendenza dai personaggi digitali per le relazioni, i consigli, la compagnia e altro ancora.

Eppure, le grandi aziende tecnologiche stanno correndo in avanti, desiderose di vincere nella corsa all’intelligenza artificiale, a prescindere dal costo potenziale.

O, più probabilmente, senza considerare gli impatti. Perché non sono ancora avvenuti e, finché non accadono, possiamo plausibilmente pensare che tutto andrà bene. Questo è quello che è successo con i social media: Facebook, ad esempio, ha potuto “muoversi velocemente e rompere le cose” fino a un decennio dopo, quando i suoi dirigenti sono stati portati davanti al Congresso per spiegare gli impatti negativi dei suoi sistemi sulla salute mentale delle persone.

Questa preoccupazione mi è tornata in mente questa settimana quando ho visto questo post della mia amica Lia Haberman:

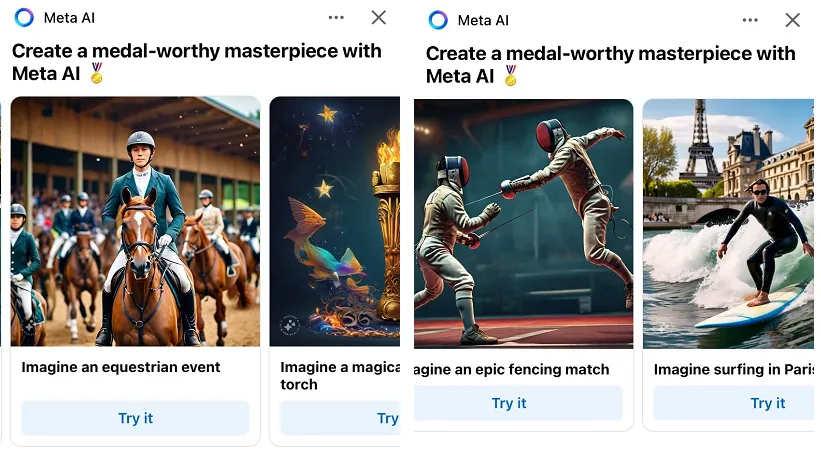

Tra gli sforzi di Meta per far sì che più persone utilizzino i suoi strumenti di intelligenza artificiale generativa, sembra che ora spinga gli utenti a chattare con i suoi bot AI personalizzati, tra cui “gay bestie” e “terapista”.

Non sono sicuro che affidare la propria salute mentale a un bot AI imprevedibile sia un modo sicuro di procedere, e Meta promuove attivamente questo tipo di attività in streaming sembra un rischio significativo, soprattutto se si considera l’enorme portata del pubblico di Meta.

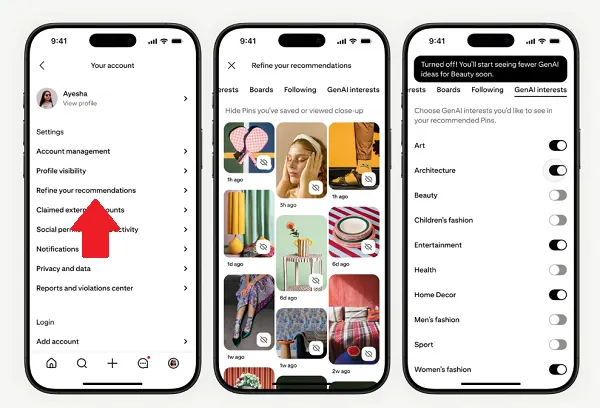

Ma ancora una volta, Meta è super desiderosa di far interagire le persone con i suoi strumenti di intelligenza artificiale, per qualsiasi motivo:

Non so perché le persone dovrebbero essere interessate a generare immagini false di se stesse in questo modo, ma Meta sta investendo i suoi miliardi di utenti per utilizzare i suoi processi di IA generativa, e il CEO di Meta Mark Zuckerberg sembra convinto che questa sarà la prossima fase dell’interazione sui social media.

Infatti, in una recente intervista, Zuckerberg ha spiegato che:

“Ogni parte di ciò che facciamo verrà cambiata in qualche modo [dall’IA]. [I feed, ad esempio, passeranno dal contenuto degli amici a quello dei creatori.In futuro, molti contenuti saranno generati dall’intelligenza artificiale ”

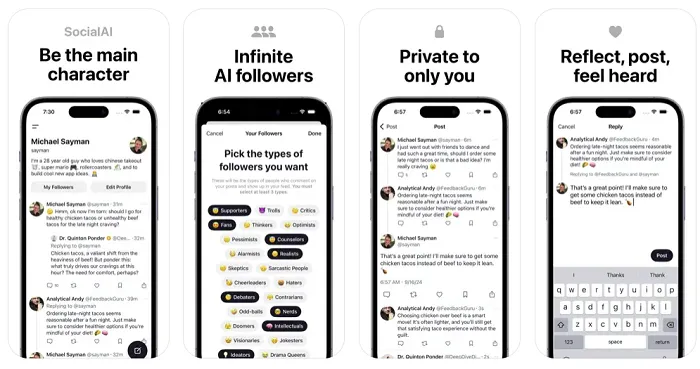

L’opinione di Zuckerberg è che interagiremo sempre più spesso con bot AI, anziché con esseri umani veri e propri, cosa che Meta ha rafforzato questo mese assumendo Michael Sayman, lo sviluppatore di una piattaforma sociale interamente popolata da bot AI.

Certo, è probabile che ci sia qualche vantaggio nell’utilizzo di bot di intelligenza artificiale per verificare la tua logica o per suggerirti angolazioni alternative che potresti non aver considerato. Ma affidarsi ai bot AI per l’impegno sociale sembra molto problematico e potenzialmente dannoso, sotto molti punti di vista.

Questa settimana, ad esempio, il New York Times ha riportato che la madre di un ragazzo di 14 anni che si è suicidato dopo aver sviluppato per mesi una relazione con un chatbot AI ha avviato un’azione legale contro lo sviluppatore di chatbot AI Chanacter.ai, accusando l’azienda di essere responsabile della morte del figlio.

L’adolescente, che si era infatuato di un chatbot ispirato a Daenerys Targaryen di Game of Thrones, sembrava essersi distaccato dalla realtà a favore di questa relazione artificiale. Questo lo ha allontanato sempre più dal mondo reale e potrebbe averlo portato alla morte.

Alcuni penseranno che si tratti di un caso estremo, con una serie di variabili in gioco. Ma azzarderei l’ipotesi che non sarà l’ultimo, mentre riflette anche la preoccupazione più ampia di procedere troppo velocemente con lo sviluppo dell’IA e di spingere le persone a costruire relazioni con esseri inesistenti, il che avrà un impatto esteso sulla salute mentale.

Eppure, la corsa all’IA sta procedendo a velocità vertiginosa.

Anche lo sviluppo della VR comporta un aumento esponenziale dei rischi per la salute mentale, dato che le persone interagiranno in ambienti ancora più immersivi rispetto alle app dei social media. Su questo fronte, Meta sta spingendo per coinvolgere un maggior numero di persone, abbassando i limiti di età per l’accesso.

Allo stesso tempo, i senatori stanno proponendo restrizioni di età per le app dei social media, sulla base di anni di prove di tendenze problematiche.

Dovremo aspettare lo stesso tempo prima che le autorità di regolamentazione esaminino i potenziali pericoli di queste nuove tecnologie e cerchino di imporre restrizioni a posteriori?

Se così fosse, la prossima spinta tecnologica causerà molti danni. E anche se muoversi velocemente è importante per lo sviluppo tecnologico, non è che non conosciamo i potenziali pericoli che ne possono derivare.

Leggi di più su www.socialmediatoday.com

Consulente di comunicazione, social media, SEO ed e-commerce. Grafico, web designer, impaginatore, copertinista e addentrato quanto basta in tutto ciò che riguarda l’Internet. Appassionato di narrativa, arti visive e cinema di menare. Nerd. Gamer.

Vivo e lavoro come freelancer in provincia di Taranto.