Con i chatbot di intelligenza artificiale che ci accompagnano praticamente in ogni app ed esperienza online, sta diventando sempre più comune per le persone conversare con questi strumenti e persino provare un livello di amicizia con i loro compagni di intelligenza artificiale preferiti nel corso del tempo.

Ma si tratta di una proposta rischiosa. Cosa succede quando le persone iniziano ad affidarsi ai chatbot dell’IA per avere una compagnia, o addirittura una relazione, e poi questi strumenti di chatbot vengono disattivati o si perde la connessione in altri modi?

Quali sono gli impatti sociali delle interazioni virtuali e come si ripercuoteranno sul nostro processo comunitario più ampio?

Si tratta di domande fondamentali che, in gran parte, sembrano essere trascurate in nome del progresso.

Di recente, però, lo Stanford Deliberative Democracy Lab ha condotto una serie di sondaggi, in collaborazione con Meta, per capire cosa pensano le persone dell’impatto dell’interazione con l’IA e quali limiti dovrebbero essere implementati nel coinvolgimento dell’IA (se ce ne sono).

Secondo Stanford:

“Ad esempio, quanto dovrebbero essere umani i chatbot dell’IA? Quali sono le preferenze degli utenti quando interagiscono con i chatbot AI? E quali caratteristiche umane dovrebbero essere off-limits per i chatbot AI? Inoltre, per alcuni utenti, parte del fascino delle chatbot AI risiede nella loro imprevedibilità o nelle risposte talvolta rischiose. Ma quanto è troppo? Le chatbot AI dovrebbero privilegiare l’originalità o la prevedibilità per evitare di offendere?”

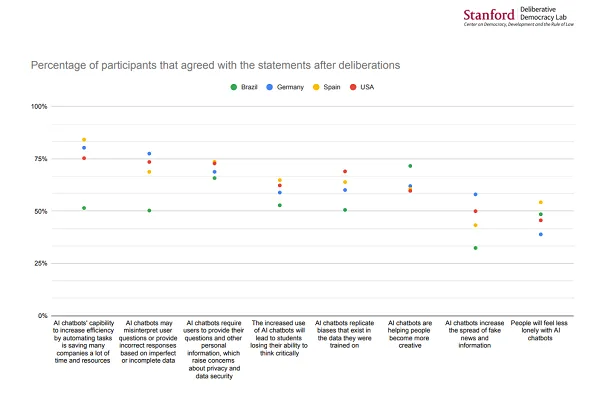

Per avere un’idea più precisa della risposta generale a queste domande, che potrebbero anche aiutare a guidare i piani di sviluppo dell’IA di Meta, il Democracy Lab ha recentemente intervistato 1.545 partecipanti di quattro paesi (Brasile, Germania, Spagna e Stati Uniti) per conoscere il loro pensiero su alcuni di questi problemi.

Puoi consultare il rapporto completo qui, ma in questo post daremo un’occhiata ad alcune delle note principali.

Innanzitutto, lo studio mostra che, in generale, la maggior parte delle persone vede nell’uso dell’IA potenziali vantaggi in termini di efficienza, ma meno nella compagnia.

Si tratta di un’interessante panoramica della risposta generale all’IA, su una serie di elementi chiave.

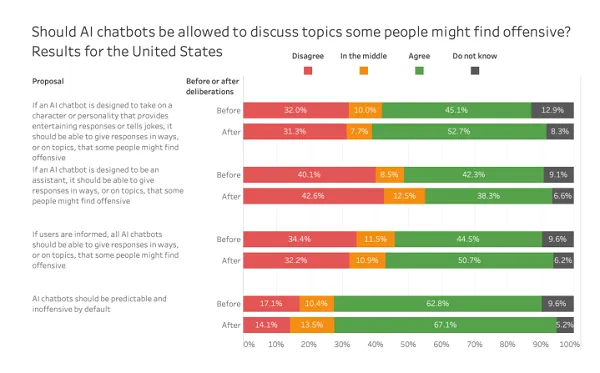

Lo studio ha poi posto domande più specifiche sui compagni dell’IA e sui limiti da porre al loro utilizzo.

In questa domanda, la maggior parte dei partecipanti ha indicato di essere d’accordo con i chatbot che affrontano argomenti potenzialmente offensivi, anche se circa il 40% è contrario (o si trova nel mezzo).

Il che è interessante se si considera la più ampia discussione sulla libertà di parola nei media moderni. Sembrerebbe che, data l’attenzione a questo tema, la maggior parte delle persone lo consideri una preoccupazione maggiore, ma la divisione in questo caso indica che non c’è un vero e proprio consenso su ciò che i chatbot dovrebbero essere in grado di affrontare.

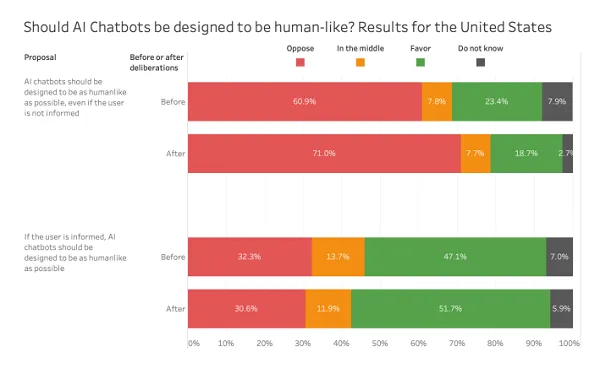

Ai partecipanti è stato anche chiesto se ritengono che i chatbot AI debbano essere progettati per replicare gli esseri umani.

C’è quindi un livello significativo di preoccupazione riguardo al fatto che i chatbot AI svolgano un ruolo simile a quello umano, soprattutto se gli utenti non sono informati del fatto che stanno interagendo con un bot AI.

Il che è interessante nel contesto del piano di Meta di sguinzagliare un esercito di profili bot AI nelle sue app e di farli interagire su Facebook e IG come se fossero persone reali. Meta non ha ancora fornito informazioni specifiche su come funzionerebbe, né sul tipo di informazioni che intende mostrare per i profili dei bot AI. Tuttavia, le risposte ricevute suggeriscono che le persone vogliono essere informate in modo chiaro, invece di cercare di far passare questi bot come persone reali.

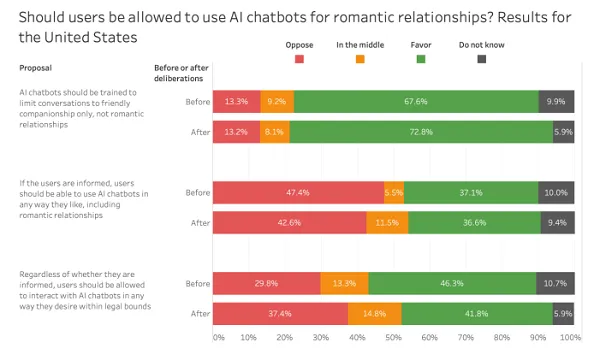

Inoltre, le persone non sembrano particolarmente a loro agio con l’idea di chatbot AI come compagni romantici:

I risultati mostrano che la stragrande maggioranza delle persone è favorevole a restrizioni sulle interazioni con l’IA, in modo che gli utenti (idealmente) non sviluppino relazioni romantiche con i bot, mentre c’è una divisione abbastanza equa di persone favorevoli e contrarie all’idea che le persone possano interagire con i chatbot dell’IA come vogliono “entro i limiti legali”

Come già detto, si tratta di un’area particolarmente rischiosa, sulla quale non abbiamo ancora abbastanza ricerche per valutare i benefici o gli impatti sulla salute mentale. Sembra che questo possa essere un modo per nuocere, ma forse il coinvolgimento romantico con un’intelligenza artificiale potrebbe essere benefico in molti casi, per affrontare la solitudine e l’isolamento.

Ma si tratta di qualcosa che necessita di uno studio adeguato e che non dovrebbe essere permesso o promosso di default.

Il rapporto completo, a cui puoi accedere qui, contiene molte altre informazioni e solleva alcune domande fondamentali sullo sviluppo dell’IA e sulla nostra crescente dipendenza dai bot IA.

Questo fenomeno è destinato a crescere e per questo motivo abbiamo bisogno di ulteriori ricerche e approfondimenti da parte della comunità su questi elementi per fare scelte più consapevoli sullo sviluppo dell’IA.

Leggi di più su www.socialmediatoday.com

Consulente di comunicazione, social media, SEO ed e-commerce. Grafico, web designer, impaginatore, copertinista e addentrato quanto basta in tutto ciò che riguarda l’Internet. Appassionato di narrativa, arti visive e cinema di menare. Nerd. Gamer.

Vivo e lavoro come freelancer in provincia di Taranto.