Secondo quanto riportato da Digitaltrends, Google starebbe testando internamente “Remy”, un agente di intelligenza artificiale autonomo progettato per operare h24 nella vita quotidiana e lavorativa degli utenti. Questa mossa, che rincorre il successo virale di progetti open-source come OpenClaw, solleva seri dubbi sulla reale capacità di Mountain View di bilanciare automazione estrema, sicurezza dei dati e utilità pratica senza trasformare l’assistente in un incubo per la privacy.

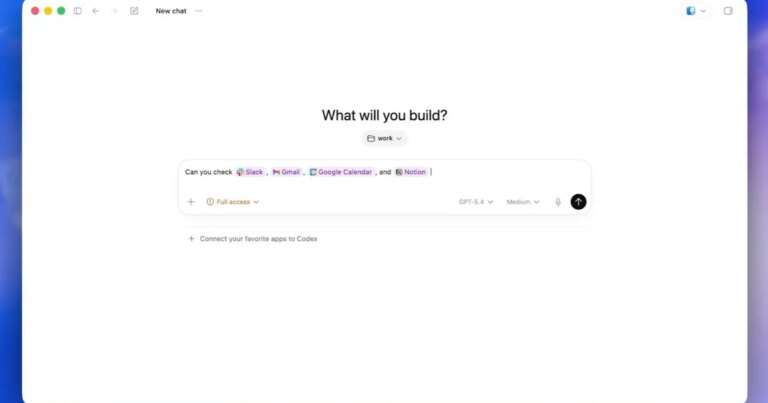

L’idea che Google possa lanciare un agente AI capace di agire autonomamente per conto nostro è affascinante quanto inquietante. Remy, attualmente in fase di test all’interno dell’app Gemini, viene descritto come uno strumento in grado di monitorare priorità, gestire compiti complessi e apprendere le preferenze dell’utente nel tempo. Tuttavia, la promessa di un’automazione “proattiva” si scontra con la realtà storica di Google: un ecosistema spesso frammentato e un modello di business basato sulla raccolta dati che mal si concilia con l’idea di un agente che ha il controllo totale sulle comunicazioni e i file personali.

La rincorsa a OpenClaw e il nodo della sicurezza

Il progetto Remy appare chiaramente come una reazione a OpenClaw, l’agente open-source che ha scosso il settore portando persino a un aumento dei prezzi dei MacBook usati in Cina. Sebbene Google possa offrire un’integrazione più fluida rispetto a soluzioni amatoriali, restano aperte le criticità sollevate dagli esperti di sicurezza riguardo a questi sistemi. Se OpenClaw è stato criticato per vulnerabilità come le credenziali salvate in chiaro, un agente Google che vive nel cloud e gestisce l’intera vita digitale dell’utente espone a rischi di scala infinitamente superiore in caso di violazione o di semplici “allucinazioni” comportamentali.

Un mercato affollato di promesse ambigue

Google non è sola in questa corsa forsennata. Con Anthropic che propone Claude Cowork e Meta che ha lanciato My Computer, il rischio è quello di trovarsi sommersi da agenti che promettono di liberarci dal lavoro, ma che in realtà aggiungono un ulteriore livello di complessità e dipendenza tecnologica. Persino Nvidia sta tentando la via dell’open-source con NemoClaw, suggerendo che il futuro non sarà fatto di semplici chat, ma di bot che cliccano ed eseguono al posto nostro.

Le preoccupazioni sollevate dagli esperti riguardo ai pericoli degli agenti autonomi non sembrano frenare Big G. Nonostante il potenziale di “prompt injection” e accessi non autorizzati, Google punta sulla fiducia nel brand per vincere il mercato. Resta da vedere se, durante il prossimo Google I/O a fine maggio, l’azienda saprà presentare Remy come qualcosa di più di un semplice esperimento per non apparire obsoleta di fronte alla concorrenza più agile.

Consulente di comunicazione, social media, SEO ed e-commerce. Grafico, web designer, impaginatore, copertinista e addentrato quanto basta in tutto ciò che riguarda l’Internet. Appassionato di narrativa, arti visive e cinema di menare. Nerd. Gamer.

Vivo e lavoro come freelancer in provincia di Taranto.