L’adozione di un nuovo paradigma architetturale basato sulla separazione tra logica operativa e strategie di inferenza promette di risolvere i problemi di scalabilità e affidabilità degli agenti IA, permettendo alle imprese di gestire flussi di lavoro complessi senza riscrivere il codice per ogni nuova iterazione del modello.

Il passaggio dai prototipi di intelligenza artificiale generativa a sistemi pronti per la produzione industriale si scontra oggi con un ostacolo ingegneristico fondamentale: la natura stocastica dei Large Language Models (LLM). Come analizzato da Artificialintelligence-news, l’imprevedibilità intrinseca dei modelli costringe spesso gli sviluppatori a contaminare la logica di business con complessi cicli di gestione degli errori e tentativi di recupero. Questa frammentazione del codice crea un debito tecnico significativo, rendendo i sistemi rigidi e difficili da manutenere quando si tenta di scalare le operazioni a livello aziendale.

Il superamento del groviglio tra logica e ricerca

Le metodologie attuali tendono a sovrapporre il “cosa” un agente deve fare con il “come” deve navigare l’incertezza. Per risolvere questa criticità, un gruppo di ricercatori provenienti da Asari AI, MIT CSAIL e Caltech ha proposto un modello di programmazione denominato Probabilistic Angelic Nondeterminism (PAN), implementato attraverso il framework Python ENCOMPASS. L’innovazione risiede nella possibilità di scrivere il percorso lineare di un flusso di lavoro, delegando le strategie di esecuzione (come il backtracking o la beam search) a un motore di runtime separato.

Scalabilità e controllo nei flussi aziendali

L’approccio basato su ENCOMPASS introduce il concetto di agenti “program-in-control”. A differenza dei sistemi dove l’LLM ha il controllo totale, qui il codice definisce rigorosamente il perimetro operativo, invocando l’intelligenza artificiale solo per compiti specifici. Attraverso l’uso di marcatori chiamati branchpoint(), gli sviluppatori possono identificare i punti di inaffidabilità senza dover strutturare manualmente ogni possibile ramificazione del processo. I vantaggi analitici sono evidenti:

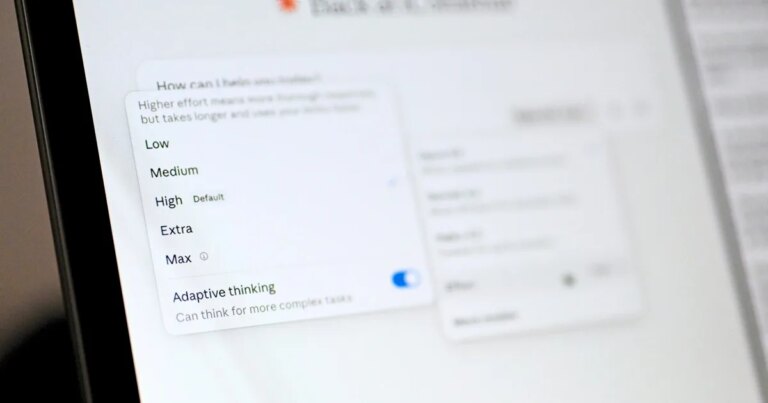

- Sperimentazione efficiente: È possibile cambiare strategia di ricerca (es. da una semplice campionatura a una ricerca Monte Carlo) senza modificare la logica di base.

- Ottimizzazione dei costi: I dati della ricerca mostrano che strategie di ricerca sofisticate possono superare i risultati dei semplici cicli di feedback, riducendo il costo computazionale per singola attività.

- Manutenibilità: La separazione tra i livelli permette di aggiornare i modelli sottostanti o le strategie di governance senza dover revisionare l’intero database di agenti.

Implicazioni per la migrazione del codice e la governance

L’efficacia di questo distacco funzionale è stata testata in scenari critici come la traduzione di codice legacy da Java a Python. Mentre le implementazioni tradizionali richiedono macchine a stati complessi e difficili da leggere, il nuovo framework mantiene il codice lineare e comprensibile, migliorando le prestazioni in modo proporzionale all’investimento computazionale. Tuttavia, restano sfide aperte: gli ingegneri devono ancora definire metriche di successo precise per permettere al sistema di “punteggiare” correttamente i diversi percorsi di esecuzione. In settori regolamentati, questa architettura modulare diventa essenziale, poiché facilita l’audit dei processi decisionali e garantisce una maggiore trasparenza rispetto agli agenti completamente autonomi.

Consulente di comunicazione, social media, SEO ed e-commerce. Grafico, web designer, impaginatore, copertinista e addentrato quanto basta in tutto ciò che riguarda l’Internet. Appassionato di narrativa, arti visive e cinema di menare. Nerd. Gamer.

Vivo e lavoro come freelancer in provincia di Taranto.