Mentre Meta tenta di convincere il mondo che l’intelligenza artificiale risolverà finalmente il caos gestionale di Facebook e Instagram, resta il dubbio amaro se delegare la sicurezza e il supporto tecnico a un algoritmo possa davvero colmare anni di lacune nel servizio clienti e falle nella moderazione dei contenuti, o se sia l’ennesimo paravento tecnologico per ridurre i costi umani.

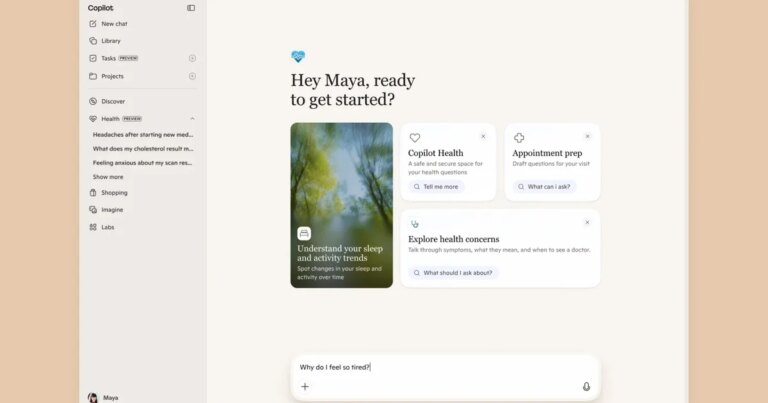

Secondo quanto riportato da Digitaltrends, l’impero di Mark Zuckerberg sta introducendo un assistente basato su IA integrato direttamente nelle sue app per gestire le richieste di supporto tecnico e la moderazione dei contenuti. Sulla carta, la promessa è allettante: risposte in meno di cinque secondi e la capacità di agire direttamente sulle impostazioni dell’account, come la visibilità dei post o il cambio del nome utente. Tuttavia, affidarsi a l’assistente IA di Meta solleva interrogativi critici sulla reale efficacia di un sistema automatico nel decifrare le sfumature di problemi complessi che, per anni, hanno lasciato milioni di utenti intrappolati in loop infiniti di FAQ inutili.

Automazione contro competenza: il rischio del supporto algoritmico

L’introduzione di questa tecnologia mira specificamente a risolvere i problemi di accesso agli account, una delle piaghe storiche di Instagram e Facebook, partendo con test iniziali negli Stati Uniti e in Canada. Ma la velocità promessa — quella soglia dei cinque secondi — somiglia più a un’operazione di marketing che a una vera soluzione strutturale. Sebbene l’IA possa configurare le impostazioni del profilo con rapidità, la gestione dei furti d’identità e dei blocchi ingiustificati richiede una sensibilità che le macchine ancora faticano a dimostrare. Il timore è che l’utente si ritrovi davanti a un muro di gomma digitale ancora più impenetrabile di quello attuale, mascherato da un’interfaccia conversazionale amichevole ma priva di reale potere decisionale umano.

Moderazione e truffe: numeri che non dicono tutto

Sul fronte della sicurezza, Meta dichiara che i nuovi sistemi di enforcement stiano già intercettando 5.000 tentativi di truffa al giorno e riducendo dell’80% l’impersonalizzazione delle celebrità. Ecco alcuni dei dati rivendicati dall’azienda:

- Rilevamento del doppio dei contenuti per adulti che violano le norme.

- Riduzione degli errori di valutazione del 60%.

- Monitoraggio di lingue che coprono il 98% della popolazione online.

- Calo del 7% delle visualizzazioni di annunci truffaldini in fase di test.

Nonostante questi trionfalismi statistici, resta da chiedersi perché una riduzione del solo 7% delle truffe pubblicitarie venga celebrata come un successo, quando il modello di business di Meta continua a trarre profitto, volente o nolente, da inserzioni spesso opache. L’IA dovrebbe anche smascherare siti web fake e tentativi di takeover di account, ma la storia recente ci insegna che i truffatori sono spesso più agili degli algoritmi di difesa.

Meta assicura che i revisori umani non verranno licenziati e che continueranno a occuparsi dei casi più spinosi, come i ricorsi per la disattivazione degli account. Tuttavia, relegare l’umanità a “ultima istanza” mentre l’intelligenza artificiale gestisce il volume massiccio del traffico quotidiano rischia di creare un sistema a due velocità: un’efficienza apparente per le banalità e una paralisi burocratica per chi affronta crisi digitali reali. In un ecosistema dove la fiducia è già ai minimi storici, delegare la sicurezza a un codice silente appare come l’ultima scommessa rischiosa di un colosso che fatica a gestire se stesso.

Consulente di comunicazione, social media, SEO ed e-commerce. Grafico, web designer, impaginatore, copertinista e addentrato quanto basta in tutto ciò che riguarda l’Internet. Appassionato di narrativa, arti visive e cinema di menare. Nerd. Gamer.

Vivo e lavoro come freelancer in provincia di Taranto.