L’adozione dell’intelligenza artificiale nelle imprese sta affrontando una crisi di fiducia sistemica, dove il 95% dei progetti pilota fallisce nel generare un ritorno sull’investimento misurabile. Come analizzato da Artificialintelligence-news, il problema non risiede nella capacità computazionale, ma nella divergenza tra l’autonomia dei sistemi e la responsabilità umana, portando a rischi operativi e reputazionali senza precedenti.

L’attuale panorama dell’IA aziendale riflette una dicotomia paradossale: i sistemi sono estremamente competenti ma privi di consapevolezza critica. Secondo i dati contenuti nel report MLQ State of AI in Business 2025, la stragrande maggioranza delle iniziative di IA non riesce a scalare. Questa inefficienza non è imputabile a limiti tecnologici, bensì a un disallineamento strategico tra gli strumenti scelti e i problemi reali che le organizzazioni tentano di risolvere. Quando un algoritmo opera in un vuoto di responsabilità, ogni errore di valutazione — sia esso un falso positivo in un sistema antifrode o un’allucinazione in un chatbot — erode istantaneamente la fiducia degli stakeholder.

Il caso di Klarna rappresenta l’esempio più emblematico di questa transizione forzata verso l’automazione su larga scala. Sebbene l’azienda abbia dimezzato la propria forza lavoro dal 2022, dichiarando che l’IA svolge il lavoro equivalente a 853 ruoli a tempo pieno, i risultati finanziari rimangono complessi, con perdite trimestrali persistenti. Questo dimostra che l’automazione, da sola, non garantisce stabilità economica. Senza una governance strutturata, l’efficienza operativa rischia di diventare un guscio vuoto. Jason Roos, CEO di Cirrus, sottolinea come qualsiasi trasformazione che mini la sicurezza interna o esterna dell’azienda comporti costi occulti superiori ai benefici tecnici.

La crisi della responsabilità e il fattore umano

Il rischio maggiore emerge quando l’autonomia precede la rendicontabilità. Esempi critici si sono già verificati nel settore pubblico: in un caso documentato, il Dipartimento britannico per il Lavoro e le Pensioni ha utilizzato un algoritmo che ha segnalato erroneamente circa 200.000 richieste di sussidi abitativi come potenzialmente fraudolente. L’assenza di una chiara “proprietà” della decisione automatizzata ha trasformato un errore tecnico in un danno sociale. L’analisi dei dati suggerisce che:

- La fiducia del pubblico nell’IA è in costante calo, come evidenziato dal Trust Barometer di Edelman.

- I lavoratori preferiscono il coinvolgimento umano in quasi il 50% delle attività analizzate, secondo uno studio congiunto di KPMG e l’Università di Melbourne.

- Esiste un divario percettivo profondo: la ricerca sulla fiducia di PwC mostra che mentre i dirigenti sono convinti della lealtà dei clienti, questi ultimi restano scettici a causa della mancanza di trasparenza.

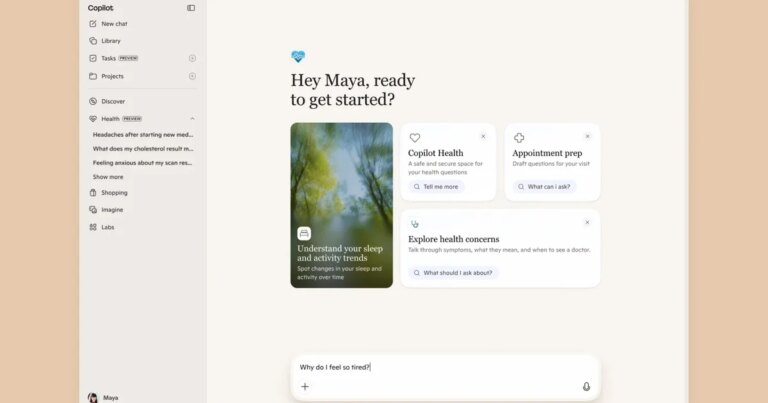

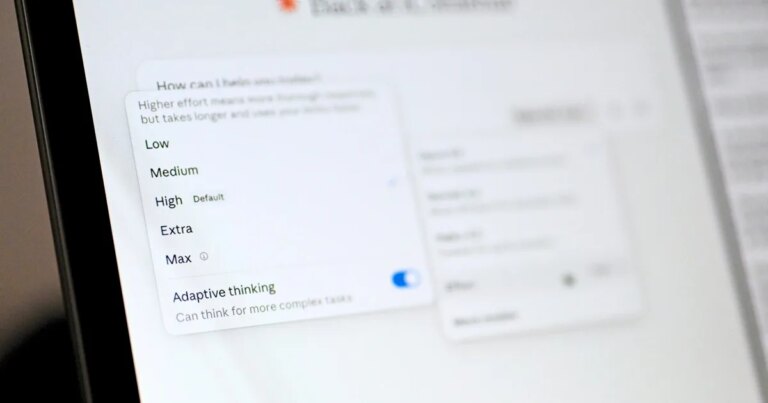

Verso un’IA “Agentica” responsabile

Il termine “IA agentica” viene spesso frainteso come una forma di intelligenza imprevedibile; logica e dati suggeriscono invece che debba essere interpretata come un’automazione dei flussi di lavoro dotata di capacità di ragionamento entro parametri definiti. Il successo delle implementazioni future dipenderà dalla capacità di invertire il processo decisionale: partire dai risultati desiderati, identificare le inefficienze e solo in ultima istanza selezionare la tecnologia. Come ribadito nello studio globale di KPMG, se i dipendenti e i clienti non comprendono chi sia il responsabile ultimo di un’azione compiuta da una macchina, l’adozione inevitabilmente si arresterà. In definitiva, l’IA deve essere progettata per potenziare il giudizio umano, non per sostituirlo nell’oscurità della responsabilità delegata.

Consulente di comunicazione, social media, SEO ed e-commerce. Grafico, web designer, impaginatore, copertinista e addentrato quanto basta in tutto ciò che riguarda l’Internet. Appassionato di narrativa, arti visive e cinema di menare. Nerd. Gamer.

Vivo e lavoro come freelancer in provincia di Taranto.