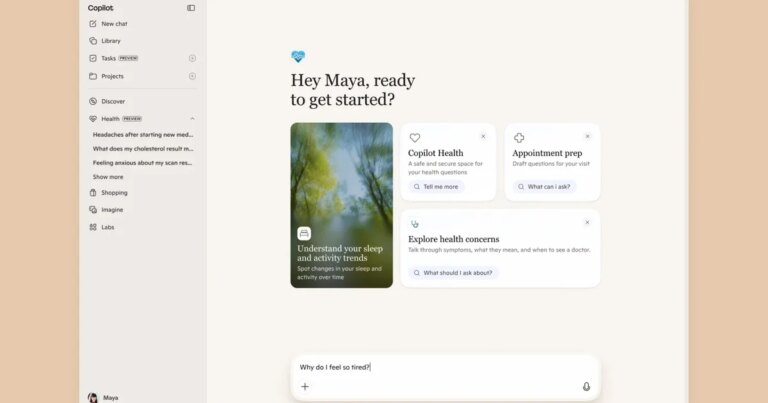

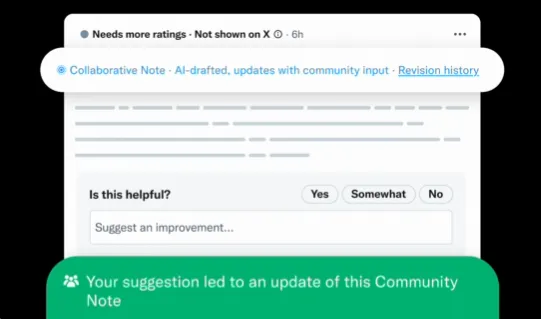

L’evoluzione del fact-checking su X attraverso l’integrazione di sistemi ibridi vede il lancio delle Note Collaborative, una funzionalità progettata per coniugare la rapidità delle bozze generate dall’intelligenza artificiale con la supervisione critica dei contributori umani, riducendo i tempi di latenza nella correzione della disinformazione in tempo reale.

Secondo quanto riportato da Social Media Today, la piattaforma X sta implementando una fase di test per le Note Collaborative, un sistema che permette agli utenti iscritti al programma Community Notes di intervenire direttamente sui contenuti prodotti dagli algoritmi. In questa architettura, quando un utente richiede una verifica, l’intelligenza artificiale genera una bozza preliminare che viene immediatamente sottoposta al vaglio della comunità. I contributori possono quindi affinare, valutare e correggere il testo in tempo reale, garantendo un equilibrio tra la velocità di risposta delle macchine e il discernimento contestuale umano.

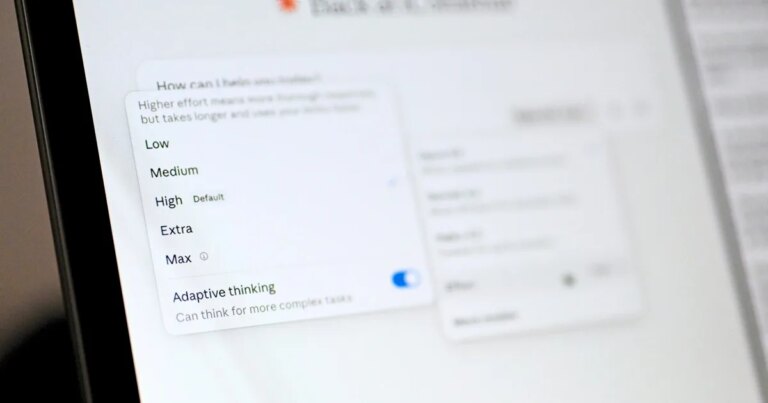

Sotto il profilo analitico, l’adozione di Note della Community generate dall’IA risponde a una criticità logistica fondamentale del microblogging: il fattore tempo. La propagazione dei contenuti virali su X avviene a una velocità tale che i processi di fact-checking tradizionali, spesso richiedenti ore o giorni, risultano inefficaci. L’IA riduce drasticamente questo gap, fornendo un punto di partenza informativo istantaneo e citando fonti che i contributori possono validare senza dover iniziare una ricerca da zero. Tuttavia, l’efficienza del modello dipende strettamente dalla qualità del dataset di addestramento e dall’assenza di bias algoritmici.

Rischi sistemici e affidabilità dei dati

- Latenza operativa: Anche un ritardo di 15 minuti può permettere a una notizia falsa di raggiungere milioni di utenti; l’IA mira a colmare questo intervallo critico.

- Bias dell’algoritmo: Poiché il sistema si appoggia a Grok, sussistono perplessità sulla neutralità delle risposte, specialmente considerando come lo stesso Elon Musk abbia ripetutamente dichiarato di voler orientare l’IA verso una direzione meno “woke”, potenzialmente influenzando l’oggettività dei fatti.

- Allucinazioni dell’IA: Casi pregressi hanno dimostrato come Grok abbia talvolta promosso informazioni false su eventi storici o attualità, evidenziando il rischio di inquinare il processo di fact-checking alla fonte.

In conclusione, sebbene l’integrazione dell’intelligenza artificiale rappresenti un progresso logico per gestire volumi massivi di dati in tempo reale, la validità finale del sistema risiede nella capacità di supervisione della comunità. Un processo di verifica basato esclusivamente su dati provenienti dal web — spesso inquinati da imprecisioni — richiede un filtro umano rigoroso per evitare che lo strumento nato per combattere la disinformazione diventi, paradossalmente, un suo veicolo di amplificazione.

Consulente di comunicazione, social media, SEO ed e-commerce. Grafico, web designer, impaginatore, copertinista e addentrato quanto basta in tutto ciò che riguarda l’Internet. Appassionato di narrativa, arti visive e cinema di menare. Nerd. Gamer.

Vivo e lavoro come freelancer in provincia di Taranto.