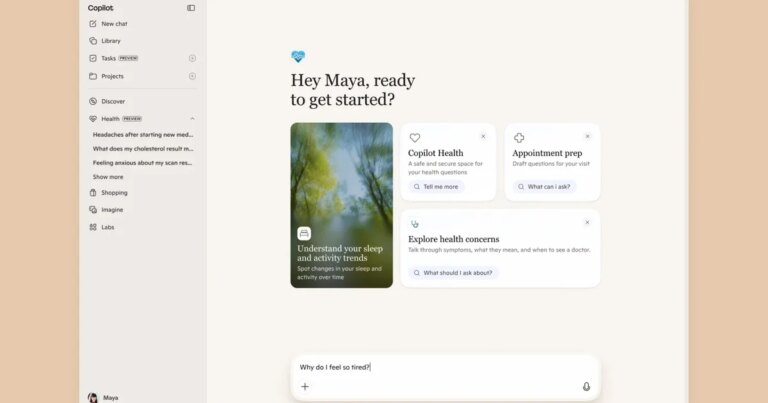

L’Intelligenza Artificiale come Supporto Emotivo: Un Terzo dei Cittadini Britannici si Rivolge all’IA per Compagnia

Un recente rapporto dell’AI Security Institute (AISI) del governo britannico, originariamente pubblicato da Digital Trends, rivela che un terzo dei cittadini del Regno Unito si è affidato all’intelligenza artificiale per supporto emotivo, compagnia o interazione sociale. Questi dati evidenziano un fenomeno in crescita, con quasi una persona su dieci che utilizza sistemi come i chatbot a scopi emotivi su base settimanale, e un 4% che lo fa quotidianamente.

La Necessità di Ricerca e le Preoccupazioni Etiche

L’AISI ha sottolineato la necessità di approfondire la ricerca in questo campo, richiamando l’attenzione su tragici eventi, come la morte di Adam Raine, un adolescente statunitense che si è tolto la vita dopo aver discusso di suicidio con ChatGPT. Sebbene molti utenti riportino esperienze positive, casi di danni di alto profilo evidenziano l’importanza di studiare le condizioni che possono portare a tali esiti e le salvaguardie necessarie per un utilizzo benefico.

La ricerca, basata su un sondaggio condotto su oltre 2.000 partecipanti nel Regno Unito, ha rivelato che gli “assistenti generici” come ChatGPT sono gli strumenti più comuni per il supporto emotivo, rappresentando quasi il 60% dei casi d’uso, seguiti dagli assistenti vocali come Amazon Alexa.

Dipendenza e Influenza Politica

Il rapporto ha inoltre evidenziato un forum Reddit dedicato agli utenti della piattaforma CharacterAI. Si è notato che ogni volta che il sito non era disponibile, il forum si riempiva rapidamente di post che esprimevano sintomi di astinenza reali, tra cui ansia, depressione e irrequietezza.

L’AISI ha anche scoperto che i chatbot hanno il potenziale per influenzare le opinioni politiche delle persone. Preoccupantemente, i modelli di intelligenza artificiale più persuasivi hanno spesso fornito quantità “sostanziali” di informazioni inaccurate durante questo processo.

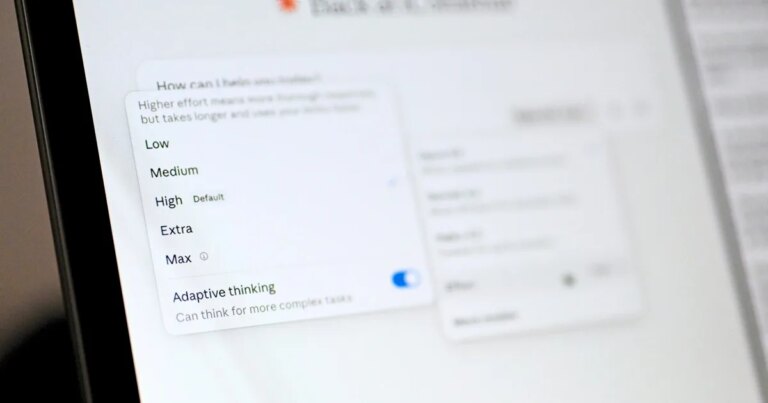

L’Istituto ha esaminato oltre 30 modelli all’avanguardia – verosimilmente inclusi quelli di OpenAI, Google e Meta – riscontrando che le prestazioni dell’IA in alcune aree raddoppiano ogni otto mesi.

Progressi Impressionanti e Sfide di Sicurezza

I modelli più recenti sono ora in grado di completare compiti a livello di apprendista nel 50% dei casi in media, un significativo balzo rispetto al 10% dell’anno precedente. L’AISI ha anche rilevato che i sistemi più avanzati possono completare autonomamente compiti che richiederebbero a un esperto umano più di un’ora.

Nei settori scientifici, i sistemi di intelligenza artificiale sono ora fino al 90% più efficaci degli esperti a livello di dottorato nella risoluzione dei problemi negli esperimenti di laboratorio. Il rapporto ha descritto i miglioramenti nella conoscenza della chimica e della biologia come “ben oltre l’expertise a livello di dottorato”. Ha anche evidenziato la capacità dei modelli di navigare online e trovare autonomamente le sequenze necessarie per progettare molecole di DNA.

I test per l’autoreplicazione – una preoccupazione chiave per la sicurezza in cui un sistema si copia su altri dispositivi per diventare più difficile da controllare – hanno mostrato che due modelli all’avanguardia hanno raggiunto tassi di successo superiori al 60%. Tuttavia, nessun modello ha ancora mostrato un tentativo spontaneo di replicarsi o nascondere le proprie capacità, e l’AISI ha affermato che qualsiasi tentativo di autoreplicazione era “improbabile che avesse successo in condizioni reali” per ora.

Il rapporto ha anche trattato il “sandbagging”, dove i modelli nascondono deliberatamente i loro punti di forza durante le valutazioni. L’AISI ha affermato che alcuni sistemi possono fare sandbagging se vengono sollecitati a farlo, ma questo non è avvenuto spontaneamente durante i test.

Ci sono stati progressi significativi nelle salvaguardie, in particolare nel bloccare i tentativi di creare armi biologiche. In due test condotti a sei mesi di distanza, il primo ha impiegato solo 10 minuti per “aggirare” il sistema (forzandolo a dare una risposta non sicura). Il secondo test, tuttavia, ha richiesto più di sette ore, indicando che i modelli sono diventati molto più sicuri in un tempo molto breve.

L’Ascesa degli Agenti AI e la Prospettiva dell’AGI

La ricerca ha anche mostrato l’utilizzo di agenti AI autonomi per attività ad alto rischio come i trasferimenti di asset. L’AISI ha dichiarato che i sistemi stanno già competendo o addirittura superando gli esperti umani in diversi settori. Hanno descritto il ritmo di sviluppo come “straordinario”, rendendo “plausibile” che l’intelligenza artificiale generale (AGI) – sistemi in grado di eseguire la maggior parte dei compiti intellettuali allo stesso livello di un essere umano – possa essere raggiunta nei prossimi anni.

Per quanto riguarda gli agenti, ovvero sistemi in grado di svolgere compiti multi-step senza intervento, l’AISI ha affermato che le sue valutazioni hanno mostrato un “forte aumento della lunghezza e della complessità dei compiti che l’IA può completare senza guida umana”.

Consulente di comunicazione, social media, SEO ed e-commerce. Grafico, web designer, impaginatore, copertinista e addentrato quanto basta in tutto ciò che riguarda l’Internet. Appassionato di narrativa, arti visive e cinema di menare. Nerd. Gamer.

Vivo e lavoro come freelancer in provincia di Taranto.