Mentre l’ecosistema tecnologico guidato da colossi come Apple e Qualcomm accelera lo sviluppo di agenti IA di nuova generazione capaci di navigare autonomamente tra le applicazioni e gestire transazioni finanziarie, emerge una strategia cautelativa che impone limiti rigorosi e checkpoint umani obbligatori, sollevando dubbi sulla reale autonomia e sull’efficienza di questi sistemi nel mercato consumer globale.

L’illusione dell’indipendenza totale delle macchine si scontra ancora una volta con la dura realtà della sicurezza informatica e della responsabilità legale. Come analizzato da Artificialintelligence-news, l’attuale traiettoria dello sviluppo di agenti IA “agentici” — sistemi progettati non solo per rispondere a domande, ma per agire concretamente — è segnata da una prudenza quasi paradossale. Apple e i big dei semiconduttori stanno costruendo assistenti digitali dotati di “freni” integrati: ogni azione sensibile, dalla prenotazione di un servizio al completamento di un pagamento, richiede un’esplicita conferma umana tramite il modello “human-in-the-loop”. Questa architettura solleva una questione critica: se l’utente deve comunque supervisionare ogni passaggio cruciale, quanto valore aggiunto offre realmente l’automazione intelligente rispetto alle interfacce tradizionali?

Il paradosso della gabbia dorata: controllo vs. innovazione

Le aziende stanno tentando di vendere questa limitazione come una funzionalità di sicurezza necessaria, ma per un osservatore critico appare come un’ammissione di fragilità del sistema. Le restrizioni non si limitano ai soli checkpoint di approvazione, ma si estendono alla “layer di controllo” che segmenta l’accesso ai dati. Invece di una visione in cui l’IA è un’entità onnipresente e fluida, ci troviamo di fronte a un sistema compartimentato.

- Accesso limitato: L’IA può interagire solo con applicazioni pre-approvate, castrando il potenziale di cross-functional automation.

- Autenticazione frammentata: La necessità di appoggiarsi a partner finanziari esterni per la verifica dei pagamenti aggiunge strati di burocrazia digitale che minano la fluidità promessa.

- Privacy “on-device”: Sebbene mantenere i dati sul dispositivo sia un vantaggio per la riservatezza, esso limita drasticamente la potenza di elaborazione e la memoria storica dell’agente rispetto ai modelli cloud-based.

Responsabilità e rischi: il fallimento non è un’opzione

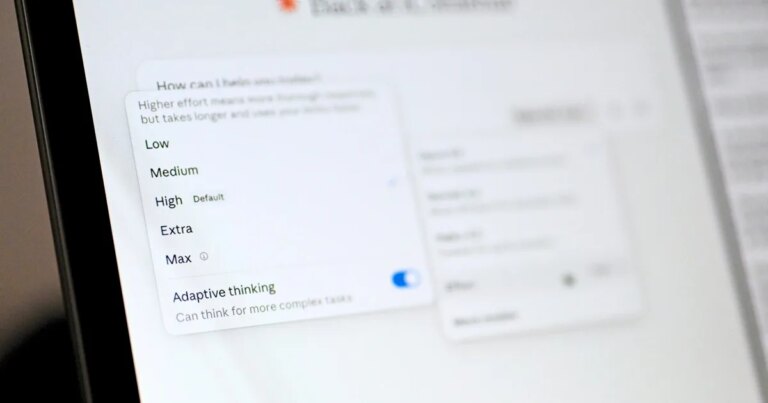

Il motivo dietro questa eccessiva cautela è evidente: il costo dell’errore. Nel momento in cui un assistente IA smette di generare testo e inizia a muovere capitali, la responsabilità legale diventa un campo minato. Un errore nel workflow di un’app potrebbe portare a perdite finanziarie reali o all’esposizione di dati sensibili. Nonostante le promesse di AI & Big Data Expo e di altri forum di settore sulle potenzialità della TechEx, la realtà è che le aziende non sono ancora pronte a fidarsi dei propri algoritmi. Questo approccio basato su “autonomia con confini” rischia di trasformare gli agenti IA in semplici macro evolute, piuttosto che in veri partner digitali, lasciando l’utente finale in un limbo tra l’automazione e la necessità di un monitoraggio costante.

In definitiva, mentre la narrazione industriale spinge verso un futuro di agenti autonomi, la struttura tecnica che stiamo osservando suggerisce una realtà molto più conservativa. Le sfide di governance, come quelle discusse riguardo alla Junseong Lee o alle normative europee, imporranno ulteriori restrizioni. Per saperne di più su questi eventi e le tendenze future, potete cliccare qui o esplorare i webinar offerti da TechForge Media consultabili qui, ma resta il sospetto che la “rivoluzione agentica” sarà molto più lenta e controllata di quanto il marketing voglia farci credere.

Consulente di comunicazione, social media, SEO ed e-commerce. Grafico, web designer, impaginatore, copertinista e addentrato quanto basta in tutto ciò che riguarda l’Internet. Appassionato di narrativa, arti visive e cinema di menare. Nerd. Gamer.

Vivo e lavoro come freelancer in provincia di Taranto.